Maszyno, ratuj jak najwięcej ludzi - ale przede wszystkim mnie!

Chociaż w samej tylko Kalifornii ponad sześćdziesiąt firm uzyskało już pozwolenia na testowanie autonomicznych samochodów osobowych, trudno mówić, by branża ta stawała się przygotowana do zmierzenia się z dylematami natury etycznej. Na razie boryka się z bardziej podstawowymi problemami - działania i sprawności nawigacyjnej systemów oraz po prostu unikania kolizji i nieprzewidzianych zdarzeń. W takich sytuacjach, jak niedawne zabicie pieszego przez samochód Ubera w Arizonie czy kolejne wypadki, chodziło póki co po prostu o błędy systemu, a nie o żaden „etyczny wybór” maszyny.

Ocalić młodych i bogatych

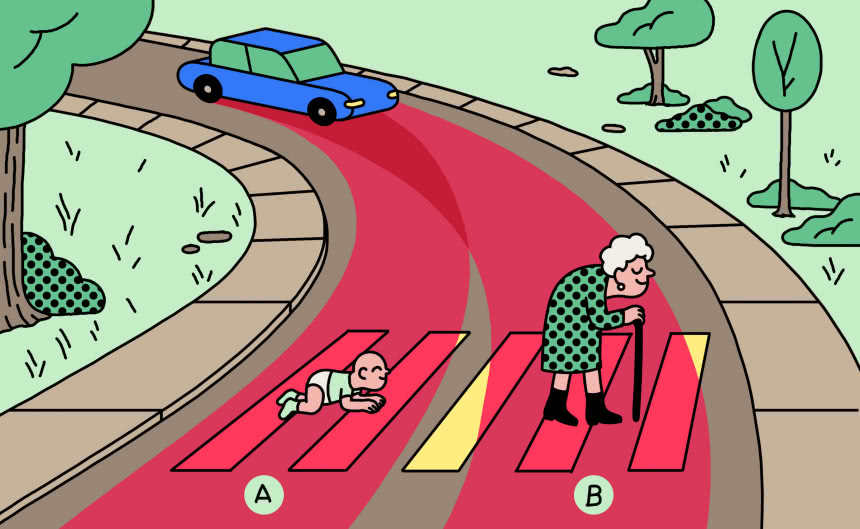

Kwestie podejmowania na drodze tego rodzaju decyzji nie są abstrakcyjnymi problemami. Może to poświadczyć każdy doświadczony kierowca. Naukowcy z MIT Media Lab przeanalizowali w ubiegłym roku ponad czterdzieści milionów odpowiedzi respondentów z całego świata, które zebrali w trakcie badań zainaugurowanych jeszcze w 2014 r. System ankietujący nazwany przez nich "Maszyną Etyczną" wykazał, że w różnych miejscach świata na podobne pytania padają różne odpowiedzi.

Najogólniejsze wnioski są do przewidzenia. W sytuacjach skrajnych ludzie przedkładają ratowanie ludzi nad troskę o zwierzęta, dążąc do tego, aby przeżyć mogło jak najwięcej istnień ludzkich i generalnie raczej osób młodszych niż starszych. Pojawiły się również pewne, ale nie tak wyraźne, preferencje, jeśli chodzi o ratowanie kobiet w porównaniu z mężczyznami, ludzi o wyższym statusie w stosunku do biedniejszych oraz pieszych, a nie pasażerów aut.

Ponieważ prawie pół miliona badanych wypełniło ankiety demograficzne, można było skorelować ich preferencje z wiekiem, płcią i poglądami religijnymi. Badacze orzekli, że różnice te nie miały "znacznego wpływu" na podejmowane przez ludzi decyzje, jednak zauważyli pewne wpływy kulturowe. Francuzi np. wykazywali skłonność do ważenia decyzji na podstawie przewidywanej liczby zabitych, natomiast w Japonii kładziono na to najmniejszy nacisk. W Kraju Kwitnącej Wiśni wyraźnie za to silniej niż na Zachodzie ceni się życie osób starszych.

"Zanim pozwolimy naszym samochodom samodzielnie podejmować decyzje etyczne, musimy przeprowadzić na ten temat globalną debatę. Gdy firmy pracujące nad autonomicznymi systemami poznają nasze preferencje, wówczas zaprojektują na ich podstawie w maszynach algorytmy etyczne, zaś politycy będą mogli zająć się wprowadzanie adekwatnych przepisów prawa", napisali w październiku 2018 r. naukowcy w "Nature".

Jeden z badaczy zaangażowanych w eksperyment „Moral Machine”, Jean-Francois Bonnefon, uznał za niepokojące preferencje ratowania osób o wyższym statusie (np. kadry kierowniczej w stosunku do osób bezdomnych). Jego zdaniem, jest to dość silnie związane z poziomem nierówności ekonomicznych w danym kraju. Tam, gdzie nierówności były większe, preferowano poświęcanie biednych i bezdomnych.

Z jednego z wcześniejszych badań wynikało m.in., że zdaniem ankietowanych autonomiczny pojazd powinien chronić jak największą liczbę osób, nawet jeśli oznacza to poświęcenie pasażerów. Zarazem jednak pytani stwierdzili, że nie kupiliby samochodu zaprogramowanego w taki sposób. Badacze tłumaczyli, że choć ludzie uznają za bardziej etyczne ratowanie większej liczby osób, to jednocześnie kierują się własnym interesem, co może być dla producentów sygnałem, że klienci niechętnie nabywać będą auta wyposażone w altruistyczne systemy. Jakiś czas temu przedstawiciele firmy Mercedes-Benz oświadczyli, że jeśli ich system miałby uratować tylko jedną osobę, to zdecydowaliby się na kierowcę, a nie pieszego. Fala publicznego oburzenia zmusiła firmę do cofnięcia tej deklaracji. Z badań wynika jednak wyraźnie, że w tym świętym oburzeniu było sporo hipokryzji.

W niektórych krajach podejmuje się już pierwsze próby regulacji prawnych w tej dziedzinie. W Niemczech przyjęto ustawę, zgodnie z którą samochody bez kierowcy muszą za wszelką cenę unikać obrażeń ciała lub śmierci człowieka. Prawo stanowi również, że algorytmy nigdy nie mogą decydować na postawie takich cech jak wiek, płeć albo zdrowie pasażerów lub pieszych.

Audi bierze na siebie odpowiedzialność

Konstruktor nie jest w stanie przewidzieć wszystkich następstw działania samochodu. Rzeczywistość zawsze może dostarczyć takiej kombinacji zmiennych, których nigdy wcześniej nie testowano. To podważa nasze przekonanie, że w ogóle da się „etycznie zaprogramować” maszynę. Wydaje nam się, że w sytuacjach, w których wystąpi błąd i dojdzie do tragedii „z winy auta”, odpowiadać powinien producent, deweloper systemu.

Być może w tym rozumowaniu jest racja, ale zapewne nie dlatego, że doszło do błędu. Raczej dlatego, że w ogóle dopuszczono do ruchu pojazd, który nie był stuprocentowo od możliwości jego popełnienia wolny. Wydaje się, że właśnie tak rozumuje i od odpowiedzialności ogólnej nie uchyla się firma Audi, która zadeklarowała niedawno, że przejmie odpowiedzialność za wypadki z udziałem modelu 2019 A8, gdy używany w nim będzie automatyczny system Traffic Jam Pilot.

Z drugiej strony, do ruchu samochodowego dopuszcza się miliony ludzi, którzy również popełniają błędy. Dlaczego więc maszyny - statystycznie popełniające o wiele mniej pomyłek niż ludzie, co potwierdzają rozliczne eksperymenty - mają być w tej mierze dyskryminowane?

Jeśli ktoś myśli, że dylematy dotyczące etyki i odpowiedzialności w świecie autonomicznych pojazdów są proste, to niech myśli dalej…