Twarz, której nie ma. Deepfake, tożsamość i nowa era manipulacji

Przypadek Marii jest zrekonstruowany na podstawie kilku podobnych spraw zgłaszanych polskiej policji i organizacjom pomocowym w latach 2023–2025. Szczegóły różnią się, wspólny jest mechanizm: technologia generatywna spadła poniżej progu dostępnego dla nastolatka z telefonem. Według raportu organizacji Sensity AI z 2019 roku ponad 96% deepfakeów w internecie stanowiły materiały pornograficzne z wizerunkiem kobiet bez ich zgody. Dziś dostęp do narzędzi jest jeszcze łatwiejszy, a skala zjawiska – według badań opublikowanych w 2024 roku – dotyka już połowy firm na świecie, które zgłosiły incydenty oszustw z użyciem sfabrykowanego audio lub wideo.

Deepfake to nie problem celebrytów i polityków. To technologia, która demokratyzuje przemoc, szantaż i dezinformację. Prawo przez lata było o kilka kroków z tyłu. W 2025 roku zaczęło nadrabiać zaległości – ale czy wystarczająco szybko?

Jak działa deepfake: od GAN do dyfuzji

Termin deepfake – złożenie angielskich słów deep learning i fake – pojawił się w 2017 roku, gdy anonimowy użytkownik Reddita zaczął publikować wygenerowane wideo z twarzami osób publicznych. Technologia była wtedy kosztowna i trudno dostępna. Dziś generowanie fakeów audiowizualnych jest możliwe przez przeglądarkę, bez specjalistycznej wiedzy.

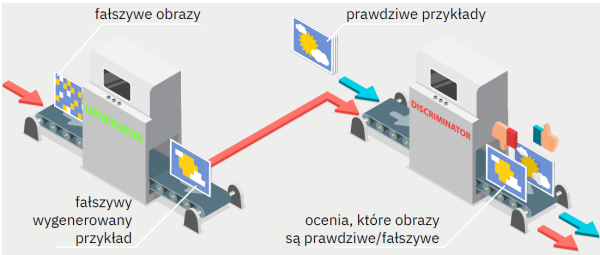

Za pierwszą falą deepfakeów stały sieci GAN – Generative Adversarial Networks, opracowane przez Iana Goodfellowa w 2014 roku. Dwie wzajemnie rywalizujące sieci neuronowe – generator i dyskryminator – uczą się nawzajem: generator tworzy coraz bardziej przekonujące fałszerstwa, dyskryminator uczy się je rozpoznawać. W praktyce dawało to realistyczne podmianki twarzy na wideo, ale wymagało mocy obliczeniowej niedostępnej dla przeciętnego użytkownika.

Obecna generacja narzędzi opiera się na modelach dyfuzyjnych – tej samej technologii, która napędza generatory obrazów. Modele dyfuzyjne uczą się odtwarzania obrazów przez stopniowe usuwanie szumu i mogą generować wysoce realistyczne twarze, pozy i konteksty na żądanie, z minimalnym wkładem użytkownika. Jakość wyjścia wzrosła dramatycznie, a próg wejścia spadł niemal do zera.

Obok deepfakeów wideo osobną kategorię stanowi voice cloning – klonowanie głosu. Współczesne systemy potrafią sklonować głos na podstawie kilkudziesięciu sekund nagrania. Efekt jest wystarczająco przekonujący, by zmylić rodzinę, znajomych, a nawet pracowników banków. Celowo nie podajemy nazw konkretnych narzędzi – są publicznie dostępne i łatwe do znalezienia przez każdego, kto ich szuka.

Taksonomia zagrożeń: cztery kategorie

Deepfake to nie jedno zagrożenie – to co najmniej cztery odrębne kategorie, różniące się ofiarami, sprawcami i skalą.

Ofiary: psychologia i prawo

Dla osób takich jak Maria problem nie kończy się na usunięciu materiału z sieci. Badania nad psychologicznymi skutkami NCII pokazują, że trauma porównywalna jest z traumami po napadach seksualnych: lęk, depresja, zaburzenia po stresie traumatycznym, izolacja społeczna, a w skrajnych przypadkach myśli samobójcze.

Non-Consensual Intimate Images – materiały intymne tworzone bez zgody osoby przedstawionej. Stanowią najczęstsze zastosowanie technologii deepfake, nieproporcjonalnie uderzające w kobiety i dziewczęta. Skala zjawiska zmusiła w 2025

roku Kongres USA do uchwalenia pierwszej federalnej ustawy w tej sprawie. Technologia demokratyzuje formę przemocy, która wcześniej wymagała fizycznego kontaktu lub skradzionych materiałów.

Nicola Henry z RMIT University, badaczka specjalizująca się w problematyce NCII, dokumentowała te skutki przez lata. Jej prace – wśród nich artykuł opublikowany w 2020 roku w International Journal of Law and Information Technology – opisują mechanizm, który sprawia, że NCII jest tak destrukcyjne: ofiara traci kontrolę nad własnym wizerunkiem i nad tym, jak jest postrzegana. Deepfake dodaje warstwę: materiał nigdy nie istniał, ale trauma jest równie realna.

W Polsce przez długi czas brakowało dedykowanego przepisu penalizującego deepfake pornograficzny. Ofiary mogły korzystać z przepisów ogólnych – o naruszeniu dóbr osobistych lub zniesławieniu – ale żaden nie był precyzyjnie dopasowany do materiału w całości wygenerowanego. Unijna regulacja AI Act, który wszedł w życie w sierpniu 2024 roku (Rozporządzenie UE 2024/1689), zmienia tę sytuację: uznaje systemy AI służące do generowania NCII za systemy wysokiego ryzyka i nakłada obowiązki transparentności, a kary za naruszenia mogą sięgać 35 milionów euro lub 7% światowego obrotu firmy.

Problem jurysdykcji pozostaje nierozwiązany. Serwery przechowujące materiał mogą znajdować się w państwie niepodlegającym europejskim regulacjom. Sprawca może być anonimowy. Procedury usunięcia treści są powolne wobec prędkości, z jaką materiał się rozprzestrzenia. Szkoda jest wyrządzana w ciągu godzin. Procedury prawne liczą się w miesiącach.

Deepfake w polityce: przypadki, które mogły zmienić historię

Deepfake polityczny to nie scenariusz z filmów. To rzeczywistość wyborcza ostatnich lat – i zjawisko, które będzie się nasilać.

W marcu 2022 roku w mediach społecznościowych pojawiło się wideo, na którym prezydent Zełenski wydawał rozkaz żołnierzom o złożeniu broni. Zostało szybko zdementowane, a jakość techniczna była wystarczająco niska, by można je było rozpoznać. Badacze dezinformacji traktowali to jako przełomowy moment: pierwszy deepfake użyty w aktywnym konflikcie zbrojnym. Następna generacja będzie trudniejsza do wykrycia.

Generowanie fałszywych wypowiedzi polityków i przywódców. Deepfake Zełenskiego z marca 2022 roku – pozorny rozkaz złożenia broni – został szybko zdementowany, bo jakość była niska. Przed wyborami na Słowacji we wrześniu 2023 roku pojawiły się nagrania audio z fałszywym głosem lidera opozycji; analitycy Digital Forensic Research Lab (Atlantic Council) ocenili je jako prawdopodobne fałszerstwo – ale po tym, jak materiał zebrał miliony wyświetleń. Kolejne wybory w Europie i na świecie w 2024–2025 roku przyniosły dalsze przypadki deepfakeów politycznych.

Przed wyborami parlamentarnymi na Słowacji we wrześniu 2023 roku pojawiły się nagrania audio z fałszywą rozmową lidera opozycji Michała Simeczki dyskutującego o kupowaniu głosów. Analitycy Digital Forensic Research Lab (Atlantic Council) ocenili nagrania jako prawdopodobne fałszerstwo – ale dementi pojawiło się po tym, jak materiał zebrał miliony wyświetleń. Simeczka przegrał wybory. Związku przyczynowego nie można udowodnić, ale chronologia jest znacząca.

Cykl wyborczy 2024–2025 – wybory prezydenckie w USA, parlamentarne w wielu krajach europejskich – przyniósł dalsze przypadki deepfakeów politycznych. W marcu 2025 roku do Kongresu USA została skierowana ustawa Protect Elections from Deceptive AI Act zakazująca świadomego rozpowszechniania deepfakeów dotyczących kandydatów w wyborach federalnych. W tym samym czasie Wielka Brytania odnotowała ponad 100 deepfakeów wideo z wizerunkiem premiera Rishiego Sunaka w fałszywych reklamach politycznych.

Problem poznawczy jest tu strukturalny. Ludzki mózg przetwarza informacje na zasadzie -pierwsze wrażenie jest trudne do zastąpienia, nawet gdy pojawi się późniejsze dementi. Badania psychologiczne nad rozumowaniem motywowanym pokazują, że ludzie chętniej przyjmują informacje potwierdzające ich wcześniejsze przekonania. Deepfake zgodny z tym, w co już wierzymy, jest wyjątkowo skuteczny.

Wykrywanie, regulacja, odporność: przełomowy rok 2025

Przez lata prawo goniło rzeczywistość. W 2025 roku ten wyścig wszedł w nową fazę.

Przełom regulacyjny w USA

19 maja 2025 roku prezydent Trump podpisał ustawę TAKE IT DOWN Act – pierwszą federalną ustawę w Stanach Zjednoczonych bezpośrednio regulującą deepfaeki. Pełna nazwa: Tools to Address Known Exploitation by Immobilizing Technological Deepfakes on Websites and Networks Act. Ustawa penalizuje świadome publikowanie niekonsensualnch intymnych wizerunków – zarówno autentycznych, jak i generowanych przez AI – oraz zobowiązuje platformy internetowe do stworzenia procedur „notice and takedown”: po otrzymaniu zgłoszenia od ofiary platforma ma obowiązek usunąć materiał. Platformy mają czas do 19 maja 2026 roku na wdrożenie tych mechanizmów.

Poza TAKE IT DOWN Act do Kongresu trafiły również: NO FAKES Act (z 9 kwietnia 2025 roku, zakazujący tworzenia repliki głosu lub wizerunku osoby bez zgody) oraz Protect Elections from Deceptive AI Act (z 31 marca 2025 roku, dotyczący deepfakeów w kampaniach wyborczych). Na poziomie stanowym: do końca sierpnia 2025 roku 47 stanów uchwaliło co najmniej jedną ustawę bezpośrednio regulującą deepfaeki. Od 2022 roku uchwalono łącznie 169 takich ustaw.

Wykrywanie: wyścig zbrojeń

Regulacje to jedno. Technologia wykrywania to drugie – i tu także postęp jest realny. Narzędzia takie jak FakeCatcher firmy Intel – analizujący subtelne sygnały przepływu krwi widoczne w wideo – osiągają według Intela skuteczność na poziomie 96% dla deepfaeków aktualnej generacji. DARPA prowadzi wieloletni program MediFor (Media Forensics) budujący systemy oceny autentyczności mediów. Problem pozostaje niezmienny: modele generatywne uczą się na sygnaturach rozpoznawanych przez detektory i omijają je w następnej iteracji.

Obiecującym podejściem systemowym jest C2PA – Coalition for Content Provenance and Authenticity – otwarty standard kryptograficznego oznaczania treści w momencie tworzenia. Kamera lub aparat podpisuje materiał metadanymi potwierdzającymi czas, miejsce i urządzenie. Każda późniejsza modyfikacja łamie podpis. Do koalicji należą m.in. Adobe, Microsoft, Google, Sony. Ograniczenie jest strukturalne: standard działa tylko wtedy, gdy łańcuch custody jest nienaruszony

od początku. Materiał generowany przez AI od zera tego łańcucha nie ma.

Klonowanie głosu dyrektora lub bliskiej osoby w celu wymuszenia przelewów. W 2019 roku firma energetyczna w Wielkiej Brytanii przelewa 220 000 euro na polecenie sklonowanego głosu CEO. Do 2024 roku połowa firm na świecie zgłosiła incydenty oszustw z użyciem sfabrykowanego audio lub wideo. Schemat „Babcia, potrzebuję pieniędzy” – znany od lat – zyskał nową skuteczność dzięki głosowi brzmiącemu dokładnie jak wnuk.

UE – AI Act

Obowiązuje od sierpnia 2024 r. Nakłada obowiązek oznaczania treści generowanych przez AI (art. 50). Kary: do 35 mln € lub 7% rocznego obrotu.

USA – TAKE IT DOWN Act

Podpisana 19 maja 2025 r. Pierwsza federalna ustawa o deepfaekach; kryminalizuje NCII, wymaga procedur takedown na platformach do maja 2026 r.

USA – poziom stanowy

47 stanów uchwaliło własne ustawy do końca 2025 r. California, Nowy Jork, Waszyngton i inne – różniące się zakresem i sankcjami.

Wielka Brytania – Online Safety Act

Obowiązuje od 2023 r. Kryminalizuje tworzenie niechcianych seksualnych deepfakeów; nakłada na platformy obowiązek szybkiego usuwania.

Chiny

1 września 2025 r. weszło w życie rozporządzenie o obowiązkowym oznaczaniu treści AI, bazujące na regulacjach z lat 2022–2023.

Tajwan

Grudzień 2025 r.: ustawa AI Basic Act zakazująca aplikacji AI naruszających prawa osobiste i bezpieczeństwo społeczne.

Polska i UE

Implementacja AI Act trwa; brak dedykowanego krajowego przepisu o deepfake pornografii – stosuje się przepisy ogólne o dobrach osobistych i AI Act.

Zakończenie: rzeczywistość jako dobro wspólne

Przez większość historii przekonanie „widziałem na własne oczy” było ostatecznym argumentem. Ten epistemologiczny fundament jest dziś naruszony.

Rok 2025 pokazał, że prawodawcy – przynajmniej w USA i Europie – zaczęli traktować deepfaki poważnie. TAKE IT DOWN Act, AI Act, dziesiątki stanowych ustaw: era prawnej ciszy dobiegła końca. Ale między uchwaleniem prawa a realną ochroną ofiary musi jeszcze powstać cała infrastruktura: procedury takedown, sprawna egzekucja, współpraca międzynarodowa.

Pierwszą linią obrony pozostaje jednak nie prawo ani technologia – lecz nawyk weryfikacji: skąd pochodzi materiał, kto go opublikował, czy renomowane agencje prasowe to potwierdziły. Pytania, które wystarczyłyby przy klasycznej dezinformacji, są nadal kluczowe. Deepfake bez dystrybucji jest bezsilny.

Maria nie jest uspokojona. Materiał został usunięty z głównych platform, ale internet nie ma pamięci, którą można wyczyścić do końca. Ona o tym wie.

Deepfake jako narzędzie w sporach prawnych: fałszywe nagrania kompromitujące stronę w procesie rozwodowym, nagrania „dowodzące” przemocy lub korupcji. Badacze prawni Farber i Vyas zwracają uwagę, że żadna ustawa ani orzeczenie sądowe nie zabraniało wprost stosowania deepfakeów jako narzędzia przesłuchań – i postulują traktowanie przyznań uzyskanych z użyciem sfabrykowanych dowodów jako niedobrowolnych w rozumieniu Piątej Poprawki.

Jak rozpoznać deepfake – 8 wskazówek

Wskazówki dotyczą materiałów aktualnej generacji. Modele uczą się – lista zmienia się wraz z technologią.

1. Mruganie i oczy

Rytm mrugania może być nienaturalny. Oczy bywają zbyt szkliste lub błyszczą nierównomiernie.

2. Krawędzie twarzy

Granica skóra–włosy lub skóra–ucho bywa rozmyta, zniekształcona lub faluje przy ruchu głowy.

3. Zęby i wnętrze ust

Generowanie zębów jest technicznie trudne – bywają zbyt regularne, rozmazane lub nieproporcjonalne.

4. Światło i cienie

Niezgodności oświetlenia twarzy i tła – szczególnie widoczne przy mocnym, kierunkowym świetle.

5. Ruch i płynność

Szybkie ruchy głowy lub gesty mogą generować artefakty widoczne klatka po klatce.

6. Niespójność kontekstu

Czy środowisko, ubranie lub tło pasują do deklarowanej okazji? Deepfaki często łączą twarz z obcym kontekstem.

7. Źródło i dystrybucja

Kto opublikował? Kiedy? Czy inne wiarygodne źródła to potwierdzają? Deepfake bez wiarygodnej dystrybucji jest bezsilny.

8. Weryfikacja techniczna

FakeCatcher (Intel), Microsoft Video Authenticator, serwisy fact-checkingowe (AFP Fact Check, Demagog.org) oferują weryfikację dla materiałów budzących wątpliwości.

Paul Bavarian

Bibliografia

1. Goodfellow I., Pouget-Abadie J., Mirza M., Xu B., Warde-Farley D., Ozair S., Courville A., Bengio Y., Generative Adversarial Nets, „Advances in Neural Information Processing Systems”, vol. 27, 2014.

2. Henry N. et al., Image-Based Sexual Abuse, „International Journal of Law and Information Technology”, vol. 28, nr 3, 2020, s. 289–309.

3. Ajder H., Patrini G., Cavalli F., Cullen L., The State of Deepfakes: Landscape, Threats, and Impact, Sensity AI, raport, 2019.

4. Digital Forensic Research Lab (DFRLab, Atlantic Council), Analiza nagrań audio dotyczących wyborów na Słowacji, wrzesień 2023 r., [online].

5. Rozporządzenie Parlamentu Europejskiego i Rady (UE) 2024/1689 z dnia … w sprawie sztucznej inteligencji (AI Act), Dz.U. UE 2024, art. 50, art. 99.

6. TAKE IT DOWN Act (Tools to Address Known Exploitation by Immobilizing Technological Deepfakes on Websites and Networks Act), Pub. L. 119–8, podpisana przez Prezydenta Stanów Zjednoczonych Donalda Trumpa 19 maja 2025 r.

7. NO FAKES Act, projekt ustawy Senatu Stanów Zjednoczonych (S. …), wniesiony 9 kwietnia 2025 r.

8. Protect Elections from Deceptive AI Act, projekt ustawy wniesiony do Kongresu Stanów Zjednoczonych 31 marca 2025 r.

9. Measures for Labeling of AI-Generated Synthetic Content, rozporządzenie Chińskiej Republiki Ludowej dotyczące oznaczania treści syntetycznych generowanych przez AI, wchodzi w życie 1 września 2025 r.

10. Artificial Intelligence Basic Act, ustawa Tajwanu dotycząca ram regulacyjnych dla sztucznej inteligencji, uchwalona w grudniu 2025 r.

11. Coalition for Content Provenance and Authenticity (C2PA), C2PA Technical Specification, wersja 2.0, 2024, [online],

dostęp: c2pa.org.

12. Online Safety Act 2023, His Majesty’s Government, Zjednoczone Królestwo.

13. Artificial Intelligence Deepfake Legislation Tracker, raport „Deepfake Legislation Tracker”, programs.com/resources/

deepfake-legislation, wyd. grudzień 2025 r.

14. Uwaga redakcyjna: Dane liczbowe wykorzystane w tekście pochodzą z raportów i analiz przywołanych w bibliografii.

Opisy regulacji prawnych oparte są na publicznie dostępnych dokumentach legislacyjnych oraz ich opracowaniach wtórnych; autor nie dysponuje pełnym tekstem aktów prawnych Chińskiej Republiki Ludowej i Tajwanu.