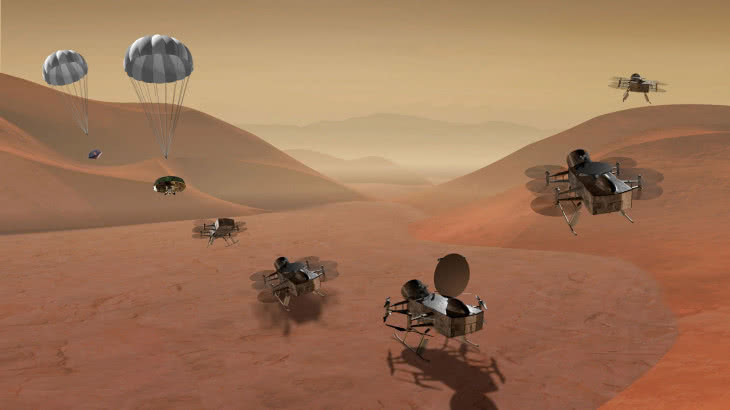

Wideo tworzone przez AI nVidii na podstawie tekstowej podpowiedzi

Technika używana w LDM dodaje czas jako kolejny wymiar, w którym operuje mechanizm generujący. Algorytm ma za zadanie oszacować, co prawdopodobnie zmieni się w każdym obszarze obrazu w określonym przedziale czasowym. Tworzy pewną liczbę klatek kluczowych w całej sekwencji, a następnie wykorzystuje inny LDM do tworzenia przejść pomiędzy nimi, generując obrazy o podobnej jakości dla każdego obrazu w sekwencji wideo. W dalszym ciągu widać, że są one generowane przez sztuczną inteligencję i nadal można znaleźć wiele dziwnych błędów. Na wielu filmach jest też widoczne, gdzie znajdują się klatki kluczowe, a wokół nich widać dziwne przyspieszenia i spowolnienia ruchu. Jeśli chodzi o samą jakość obrazu, według zgodnej oceny ekspertów, postęp jest ogromny.

nVidia przetestowała system, wykorzystując niskiej jakości materiał filmowy w stylu kamery samochodowej i ustaliła, że jest w stanie wygenerować kilkuminutowy materiał tego typu w sposób "spójny czasowo", przy rozdzielczości 512×1024 pikseli. Jest on zdolny do działania w znacznie wyższych rozdzielczościach i w ogromnej gamie różnych stylów wizualnych. Zespół wykorzystał system do wygenerowania mnóstwa przykładowych filmów w rozdzielczości 1280×2048 pikseli, jedynie na podstawie podpowiedzi tekstowych. Każdy z tych filmów zawiera 113 klatek i jest renderowany z prędkością 24 klatek na sekundę, dlatego trwa około 4,7 sekundy.

Źródło: newatlas.com, zdjęcie: research.nvidia.com

Prezentacja wielu przykładów filmów wygenerowanych przez LDM i wyjaśnienie działania modelu: research.nvidia.com

Mirosław Usidus