Co potrafi dobrze wyspany algorytm

W lecie 2020 r. jeden z najlepszych amerykańskich pilotów myśliwców przegrał w serii symulowanych walk powietrznych ze sztuczną inteligencją. O pilocie wiemy tylko, że jego znak wywoławczy to "Banger" i ukończył on kurs instruktorski obsługi broni pokładowej, do którego dopuszczani są wyłącznie najlepsi piloci. Jego pogromca, system AI autorstwa niewielkiej firmy Heron Systems, pokonał wcześniej kilka innych algorytmów sztucznej inteligencji. Symulowane walki odbywały się w ramach prowadzonego przez agencję DARPA programu AlphaDogfight Trials. AI kontrolująca myśliwiec F-16 stanęła do walki z jednym z czołowych pilotów US Air Force. Rozegrano pięć symulowanych pojedynków (1). Człowiek przegrał wszystkie.

To kolejna z porażek człowieka z AI, których w ostatnich latach mieliśmy całą serię. W 2017 r. np. sztuczna inteligencja pokonała zawodowych pokerzystów, zgarniając z puli 1,7 mln USD. Wygrana w tej grze jest czymś znacznie trudniejszym niż warcaby czy szachy, choć formalnie reguły są proste. Algorytmy były w sytuacji, w której miały do czynienia z niepełną i niedoskonałą informacją. Podczas gry w szachy zawsze widać położenie wszystkich pionków, zawsze wiadomo, jakie są ich możliwe ruchy i co się wydarzy po ich dokonaniu. Poker to rozgrywka w innej sferze. Niby coś wiadomo, ale do końca nie jest pewne, jakie karty ma przeciwnik. Do tego dochodzi jeszcze kwestia blefowania. Maszyna musi nauczyć się nauczyć rozpoznawać oszustwo lub też sama próbować wprowadzać przeciwników w błąd.

Program Libratus (2), który ograł profesjonalistów w pokera, zdobył już sławę, a firmy z całego świata zaczęły badać możliwość wykorzystywania go w rozwiązywaniu problemów. Tuomas Sandholm, profesor informatyki na Uniwersytecie Carnegie Mellon, twórca Libratusa, twierdzi, że program może zostać wykorzystany w różnych innych sytuacjach, w których informacja jest niekompletna, np. w negocjacjach biznesowych, opracowaniu wojskowych taktyk i strategii, cyberbezpieczeństwie a także w medycynie. Z tego, co wiadomo o tym maszynowym pokerzyście, nikt nie podsuwał mu sprawdzonych sposobów na grę. Po prostu przekazano mu zasady i nakazano opracować najlepszą strategię oraz uczyć się w trakcie gry.

Także w 2017 r. program Case Cruncher Alpha zmierzył się z setką prawników z londyńskich firm w rywalizacji, w której chodziło o rozstrzygnięcia związane z prawem ubezpieczeniowym. Każdy z uczestników konkursu otrzymał podstawowe fakty dotyczące nieprawidłowości przy sprzedaży reasekuracji kredytów. Na tej podstawie trzeba było stwierdzić, w których przypadkach były podstawy do złożenia skargi (prawidłowość kontrolowano z danymi o rzeczywistych zgłoszeniach rzecznika ubezpieczeniowego). Case Cruncher pobił ludzi na głowę. Trafność jego przewidywań wyniosła 86,6 proc., podczas gdy jego ludzie z wykształceniem prawniczym, którzy zajmują się tym od wielu lat, odgadli decyzje rzecznika w 66,3 proc. przypadków.

Oczywiście niejeden raz AI pokonywała graczy w gry komputerowe. Jednym z najgłośniejszych przypadków była wygrana OpenAI Five (3) z grupą mistrzów gry Dota w lecie 2018 r.

Pracuje jak mózg i jak mózg potrzebuje snu

Opracowana przez naukowców z Microsoftu i Uniwersytetu Cambridge sztuczna inteligencja zadziwiła tym, że zyskała na początku 2017 r. cenną umiejętność pisania kodu programistycznego. System Deep-Coder stworzono do pomocy osobom, które chcą stworzyć własny program, lecz nie znają się na kodowaniu. Potrafi napisać program, pobierając fragmenty wierszy kodu z istniejącego oprogramowania. Deep-Coder, który korzysta z uczenia maszynowego, ćwiczy się w tym, jakie fragmenty kodu są potrzebne, aby uzyskać pożądane efekty. Potrafi szukać wymaganych linijek kodów w wielu miejscach i robi to znacznie szybciej od człowieka. Deep-Coder udowodnił, że może pisać działające programy w ułamku sekundy.

Jeszcze trudniej robi się, gdy próbujemy zaprząc ją do imitacji innych zadań intelektualnych, z którymi zmaga się ludzki mózg. Takie próby, których celem jest przede wszystkim odtworzenie poziomu efektywności energetycznej mózgu, już trwają. Powstają np. probabilistyczne sieci neuronowe. Jednak ich osiągi nie zwalają z nóg. Za to pojawiają się różne inne podobieństwa.

Naukowcy z Narodowego Laboratorium w Los Alamos w Stanach Zjednoczonych odkryli, że pewien typ sztucznej inteligencji, który stara się odwzorować działanie mózgu, też może potrzebować czegoś na kształt snu. Grupa naukowców, pracująca nad rodzajem sztucznej inteligencji, miała naśladować sposób, w jaki mózg uczy się widzieć. Działanie AI stawało się jednak niestabilne podczas długich cykli nauki. Jednak gdy robot został wprowadzony w stan, podobny do takiego, który doświadcza ludzki mózg podczas snu, to stabilność sieci neuronowej była odzyskiwana. Najlepsze rezultaty we wprowadzaniu AI w ten stan przyniósł dźwięk, który jest znany jako szum gaussowski. Naukowcy przypuszczają, że naśladuje to, co odbierają neurony podczas snu głębokiego.

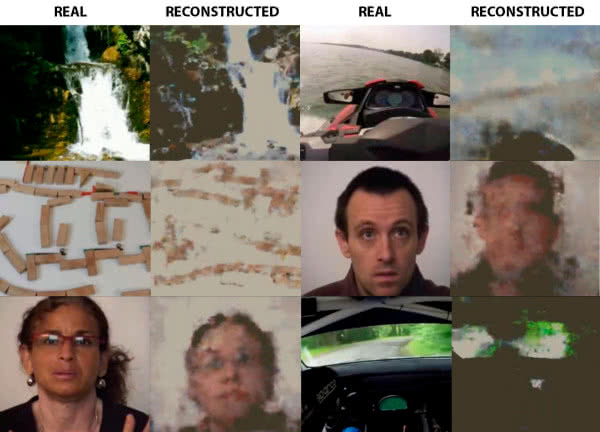

Nie wiadomo jak, ale zadziwiający w swoich możliwościach jest system opracowany przez firmę Neurobotics, który potrafi na bieżąco czytać fale mózgowe, interpretować je w locie i natychmiast generować obrazy, które widziane są przez osoby użytkujące ten sprzęt (4). Inżynierowie zbudowali dwie sieci neuronowe, jedną do generowania przypadkowych obrazów z danych kategorii na podstawie szumów i drugą do generowania podobnego szumu na podstawie EEG. Następnie wyćwiczyli obie sieci do interpretowania fal mózgowych i przekładania ich na realne obrazy, które będą jak najbardziej odzwierciedlały wszystko to, co widzi aktualnie osoba poddana testom. W ostatniej fazie testów ochotnicy oglądali materiały wideo, a EEG nagrywało fale mózgowe i transmitowało sygnały do sieci neuronowych, które natychmiast generowały przekonujące obrazy, które w 90 procentach przypadków z łatwością można było przypisać do wskazanej kategorii.

Hitem 2020 roku - generatory tekstu

Jeśli coś z dziedziny AI zadziwiło w 2020 roku, to były to na pewno generatory językowe, zwłaszcza GPT-3, który nie jest przeciętnym narzędziem. To najnowocześniejsza, autoregresywna, oparta na języku naturalnym sieć neuronowa stworzona przez laboratorium badawcze OpenAI. Opierając się na zalążku zawierającym kilka zdań GPT-3 (skrót pochodzi od słów Generative Pre-trained Transformer 3, oznaczający generatywny wstępnie wytrenowany transformator), może wygenerować imponujący dokładny tekst pasujący do stylu i treści kilku początkowych wierszy. GPT-3 może pochwalić się 175 miliardami parametrów, określających zależności między elementami sieci. I podobno kosztowało to 12 milionów dolarów.

Przełomem w tej dziedzinie badań nad AI był po raz pierwszy wprowadzony przez Google w 2017 roku Transformers, nowy rodzaj modelu głębokiej nauki. Przyczynił się do zrewolucjonizowania naturalnego przetwarzania języka. Jednak maszyny dopiero teraz zaczynają naprawdę dobrze rozumieć język. Wspomniany GPT-3 to nie jedyny imponujący model językowy powstały w 2020 roku. Turing Natural Language Generation (T-NLG) Microsoftu miał premierę w lutym 2020 roku. Przy 17 miliardach parametrów był to, w momencie udostępnienia, największy model językowy ze znanych. T-NLG jest w stanie wygenerować słowa, niezbędne do uzupełnienia niedokończonych zdań oraz bezpośrednie odpowiedzi na pytania i streszczenia dokumentów.

Inne modele, takie jak Meena, DistilBERT i BST 9.4B, również przekroczyły liczbę miliarda parametrów. Chociaż więcej parametrów nie musi oznaczać lepszej wydajności w każdym przypadku, oznacza jednak, że narzędzie do generowania tekstu jest w stanie dokładniej modelować szeroki zakres funkcji.

Artyści AI wędrują w abstrakcje

Algorytmy potrafią nas w ostatnim czasie zaskoczyć również w dokładności tzw. głębokich fałszerstw (deepfakes). Choć nie są one całkiem nowym wynalazkiem, to w ostatnich miesiącach zaczęły robić piorunujące wrażenie. W lipcu 2020 r. naukowcy z Centrum Zaawansowanej Wirtualności w Massachusetts Institute of Technology przygotowali wysokobudżetowy film wideo "Deepfake" przedstawiający prezydenta Richarda Nixona wygłaszającego przemówienie zastępcze na temat lądowania na Księżycu, które zostało napisane na wypadek, gdyby misja Apollo zakończyła się niepowodzeniem. Parę miesięcy później pojawił się film tego typu z królową Elżbietą II w roli głównej.

Od razu rodzi się pytanie o nowe, kreatywne i artystyczne możliwości AI. CAN-y (5), czyli kreatywne sieci adwersarzy, w których, mówiąc w uproszczeniu, dwie sieci neuronowe są konfrontowane ze sobą. Jedna z nich próbuje oszukać drugą, która z kolei próbuje dostrzec sztuczki pierwszej. Różnią się od generatywnych sieci kontradyktoryjnych (GAN) tym, że nie tworzą wiernych odzwierciedleń, lecz skupiają się na odchyleniach.

Tak działa m.in. robot Ai-Da, dzieło badaczy z uniwersytetów w Oksfordzie i Leeds. Humanoidalny robot nie odtwarza po prostu sfotografowanych wcześniej obrazów. Jego dzieła powstają w niespotykany dotychczas u maszyny sposób, przy użyciu "wzroku" i narzędzi. Znajdujące się w oczach kamery rejestrują znajdujące się przed nim obiekty, a następnie tworzą wirtualny wzór, osadzony w układzie współrzędnych. Z tych koordynatów korzysta zaawansowane mechaniczne ramię, trzymające ołówek lub pędzel. W ten sam sposób, bazując na tworzonej przez siebie mapie i wykorzystując zaimplementowane algorytmy, Ai-Da może również tworzyć abstrakcyjne dzieła sztuki. Działa więc inaczej niż większość artystów AI, przeważnie odtwarzających widziane obrazy.

Zaginione języki, groby, skorupki i uczeni

Osiągnięcia sztucznej inteligencji w sztuce wchodzą więc na nowe poziomy. A co z nauką? Jak się okazuje, tu też potrafi wprawić w zdumienie swoją przydatnością i możliwościami.

Badacze z Freie Universität Berlin opracowali ostatnio przełomową metodę opartą na zaawansowanej sztucznej inteligencji, która jest w stanie rozwiązać równanie Schrödingera w chemii kwantowej. Celem badań jest jak najszybsze odkrycie właściwości cząsteczek tylko na podstawie położenia ich atomów. Służy do tego algorytm o nazwie PauliNet, bazujący na sieci neuronowej. "Zamiast standardowego podejścia polegającego na komponowaniu funkcji falowej ze stosunkowo prostych składników matematycznych, zaprojektowaliśmy sztuczną sieć neuronową zdolną do uczenia się złożonych wzorów rozmieszczenia elektronów wokół jąder", powiedział w rozmowie z mediami Frank Noé, kierownik prac.

Z kolei zespół naukowców z Laboratorium Informatyki bostońskiego MIT stworzył sztuczną inteligencję, która jest w stanie automatycznie czytać i tłumaczyć z zaginionych języków. I to nawet bez zaawansowanej wiedzy na temat powiązań np. danego dialektu z innymi językami. Jak podał serwis "MIT News", celem projektu jest odkrycie związków między różnymi martwymi językami. Chociaż nie działa jak Tłumacz Google dla starożytnych tekstów, może identyfikować pochodzenie poszczególnych wyrazów. Dzięki tej nowatorskiej technologii udało się np. zbadać historię rodziny języków iberyjskich. Okazało się, że wbrew temu, co sądzono, język używany przez rdzennych mieszkańców Europy Zachodniej od VII do I wieku p.n.e. nie był wcale spokrewniony z baskijskim.

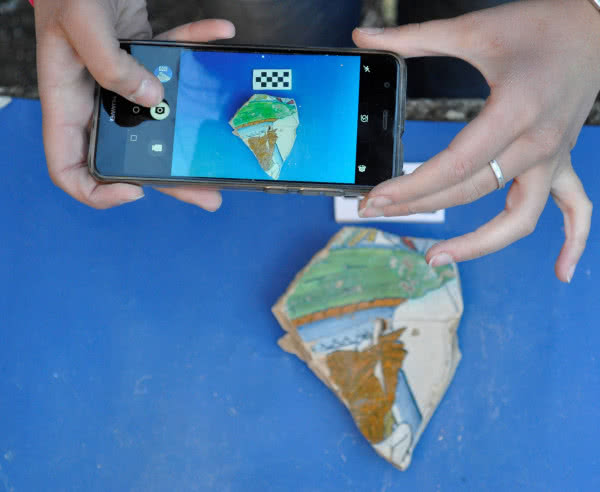

Grupa szwajcarskich uczonych wykorzystuje natomiast AI do poszukiwania grobowców scytyjskich rozsianych po euroazjatyckich stepach. Do analizy obrazów obszarów o powierzchni milionów kilometrów kwadratowych wykorzystali oni konwolucyjną sieć neuronową. Badacze przeanalizowali za jej pomocą 1212 zdjęć satelitarnych, każąc jej szukać okrągłych grobowców kamiennych. Użyli obrazów, aby wytrenować sieć w rozumieniu, jak wygląda grobowiec scytyjski, korygując system, gdy ominął znany grobowiec lub zaznaczył nieistniejący. Sieć wykazała 98-procentową skuteczność. Ich włoscy koledzy, Gabriele Gattiglia i Francesca Anichini, archeolodzy z uniwersytetu w Pizie we Włoszech, używają w ramach projektu ArchAIDE, sieci neuronowych do identyfikacji wykopywanych skorup ceramicznych (6). Także w tym przypadku AI uczyła się na skatalogowanych i opisanych obrazach znalezisk. Aż doszła do wysokiej wprawy w rozpoznawaniu i opisywaniu nowych znalezisk.

Chris Clark, inżynier z Harvey Mudd College w Claremont w Kalifornii, korzysta z podwodnego robota, skanującego sonarowo dno morskie, i z systemu rozpoznawania obrazów za pomocą sieci neuronowej do poszukiwania wraków statków i innych interesujących dla poszukiwaczy obiektów. W ostatnich latach współpracował m.in. z Timmym Gambinem, archeologiem z Uniwersytetu Maltańskiego, w przeszukiwaniu dna Morza Śródziemnego wokół Malty.

Wirtualna dziewczyna podbija serca samotnych Chińczyków

Niejednego zaskoczyć mogła, nie tylko w Chinach, ogromna popularność Xiaoice (7), dziewczyny-bota AI, z którą wirtualnie randkować może każdy, kto chce. Została pierwotnie stworzona przez grupę badaczy z Microsoft Asia-Pacific w 2014 r. Pod wieloma względami przypomina oprogramowanie typu inteligentny asystent napędzane przez AI, takie jak Siri firmy Apple czy Alexa Amazona, w którym użytkownicy mogą rozmawiać z botem za pomocą głosu lub wiadomości tekstowych w aplikacjach i urządzeniach inteligentnych.

W odróżnieniu jednak od zwykłych wirtualnych asystentów, Xiaoice została zaprojektowana tak, aby flirtować z użytkownikami. Okazuje się, że wielu samotnych Chińczyków nawiązuje z nią "stałe związki". Według twórców Xiaoice, bot dotarł do ponad sześciuset milionów użytkowników. Jej fani pochodzą głównie z Chin, głównie są to mężczyźni, często niezbyt dobrze sytuowani (czyli tzw. słabsze partie). Z analiz wynika, że potrafią się bardzo przywiązać do Xiaoice. Najdłuższa ciągła rozmowa pomiędzy użytkownikiem a Xiaoice trwała ponad 29 godzin i obejmowała ponad siedem tysięcy interakcji.

Oczywiście ten rodzaj AI rodzi mnóstwo krytyki i kontrowersji. Autorzy tworzą mnóstwo filtrów, które zapobiegają wchodzeniu w rozmowach z dziewczyną na groźne tematy, nie tylko polityczne, ale również przyprawiające użytkowników o depresję. Oprócz sprawdzania wrażliwych treści, system filtrujący firmy monitoruje stany emocjonalne użytkowników, szczególnie pod kątem oznak depresji i myśli samobójczych. Jeżeli użytkownik właśnie ma za sobą rozstanie, Xiaoice w ciągu następnych dni będzie wysyłała mu wspierające go wiadomości.

Prawdziwe misje wojskowe

Zaczęliśmy od wojska i kończymy militarnym tematem. W połowie grudnia 2020 r. samolot rozpoznawczy U-2S Dragon Lady z 9. Skrzydła Rozpoznawczego US Air Force wykonał lot ćwiczebny, w czasie którego za obsługę radaru i wybranych sensorów odpowiadała wyłącznie sztuczna inteligencja nazwana ARTUμ. Jest to pierwsze zastosowanie sztucznej inteligencji w samolocie amerykańskich sił powietrznych w służbie liniowej, a prawdopodobnie również w jakimkolwiek wojskowym samolocie na świecie. Dotychczas zastosowanie algorytmów uczących się było ograniczone do samolotów doświadczalnych. Przedstawiciele Departamentu Obrony określili to wydarzenie jako przełomowe w dążeniu do implementacji sztucznej inteligencji w samolotach bojowych. Chociaż system został sprawdzony na nieuzbrojonym U-2, przedstawiciele Departamentu Obrony poinformowali, że może być zastosowany również na innych samolotach.

ARTUμ został opracowany na bazie ogólnodostępnego algorytmu μZero opracowanego przez Deep-Mind. Do tej pory algorytm znajdował zastosowanie głównie w grach strategicznych jak szachy lub Go. Przed wykonaniem lotu testowego ARTUμ przeprowadził ponad pół miliona symulowanych misji na komputerach w laboratorium, gdzie uczył się zarządzania sensorami pokładowymi U-2S. Warto przypomnieć, iż amerykańskie siły powietrzne prowadzą również inne programy związane ze sztuczną inteligencją. Jednym z nich jest Skyborg, który ma stworzyć bezzałogowego "lojalnego skrzydłowego" zdolnego do wykonywania misji rozpoznawczych i bojowych przy minimalnym nadzorze ze strony pilota samolotu załogowego. Prowadzone są również badania nad nauczeniem sztucznej inteligencji walki powietrznej w ramach programu Air Combat Evolution.

Wiele z owych, opisanych wyżej niespodzianek, jakie sprawiała nam AI w ostatnim okresie, gdyby się nad tym zastanowić, nie jest wcale niespodzianką. Wszystkiego tego wielu z nas się spodziewało. Niektórych zaskakuje tylko, że to się dzieje tak szybko.

Mirosław Usidus

Zobacz także:

Wojny algorytmów

Egzoszkielety - skromniej znaczy skuteczniej

Egzoszkielety

Bezzałogowe systemy latające